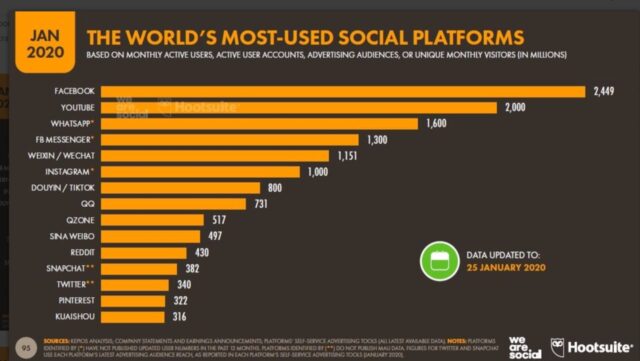

El gigante digital, junto a Twitter, Instagram y WhtasApp aplicaron severos controles para frenar la difusión de noticias falsas en las últimas elecciones de Estados Unidos. 35.000 trabajadores de Facebook operaron desde el inicio de este año en seguridad y protección de la información que recibían los 2.449 millones de usuarios activos de esta red social.

Redacción Código Vidrio

La disputa por la Casa Blanca fue una prueba de fuego para Facebook, Instagram, WhatsApp y Twitter. Las redes sociales más grandes del planeta aplicaron un control a rajatabla para frenar la desinformación durante las presidenciales de Estados Unidos.

Esta no fue una estrategia espontánea sino un plan bien estructurado que arrancó en el 2018 y que se aplicó en nuestro continente en países como Brasil, Argentina, México, Colombia, Perú y Bolivia. Y según comentó un funcionario de esta compañía a Código Vidrio también se aplicará en Ecuador en las elecciones de febrero del próximo año.

Facebook conocía que la prueba más dura estaba en la contienda entre el demócrata Joe Biden y el republicado Donald Trump. “Hace tiempo que sabíamos que la elección de 2020 en Estados Unidos sería diferente a cualquier otra. Nos hemos estado preparando para esta elección única con un paquete específico de productos y políticas”, publicó Facebook, la víspera de los sufragios.

35.000 trabajadores de esta compañía operaron desde el inicio de este año en seguridad y protección de la información que recibían los usuarios de esta red social. Por eso, entre marzo y septiembre de este año, eliminaron 120.000 contenidos en Facebook e Instagram que violaron sus “políticas de interferencia al voto”.

Además, colocaron advertencias en más de 150 millones de contenidos en Facebook desde Estados Unidos. Según la empresa, estos mensajes fueron observados por sus equipos de verificadores de datos independientes.

Estos equipos de comprobación están conformados por medios de comunicación y organizaciones sin fines de lucro. En Ecuador estos verificadores también funcionan en una alianza con la agencia francesa de noticias AFP y con Ecuador Chequea, de Fundamedios.

Facebook también removió alrededor de 30 redes alrededor del mundo que estuvieron calificadas como “comportamiento inauténtico coordinado, incluyendo interferencia extranjera o gubernamental. Algunas estaban dirigidas a EE.UU.”.

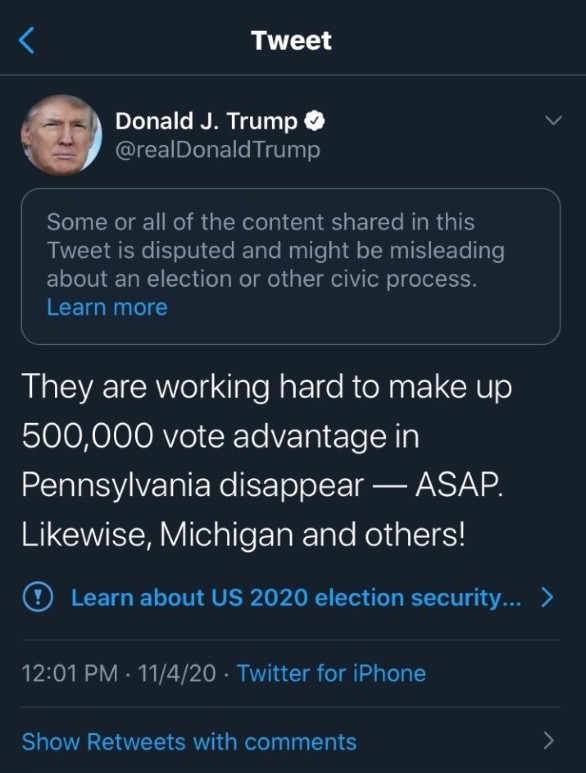

Twitter bajó varios tuits del presidente Trump por violar sus políticas

Restricción de anuncios

La publicidad también fue controlada. La red social anunció que rechazó solicitudes de anuncios antes de que fueran publicados aproximadamente 2,2 millones de veces. Lo hicieron porque a su criterio no completaron el proceso de autorización.

Twitter no se quedó atrás en esta batalla. Este año emprendió su plan para etiquetar el contenido político, identificando a instituciones y medios de comunicación ligados estrictamente a gobiernos.

En EE.UU. las primeras en ser etiquetadas fueron: @POTUS, que es la cuenta oficial de quien ocupe el cargo de Presidente de los Estados Unidos. Lo mismo sucedió con @WhiteHouse, que tiene el membrete de institución gubernamental.

Adicionalmente, empezó a advertir a sus usuarios sobre contenido político que puede ser engañoso. Sin embargo, desde septiembre pasado la compañía anunció que no solo etiquetará sino que eliminará cualquier información que intente afectar las elecciones. En su lista de prohibiciones se encontraban por ejemplo: las afirmaciones falsas sobre cómo participar en los sufragios; contenido que pueda intimidar la participación en las elecciones; los reclamos que puedan “socavar la fe” en el proceso electoral y las afirmaciones sobre los resultados de los sufragios.

“No permitiremos que se abuse de nuestro servicio en torno a procesos cívicos, principalmente elecciones”, escribió en un comunicado en septiembre

Bajo estas condiciones, Twitter etiquetó diez mensajes que envió Trump luego de conocer los resultados que no favorecían a su campaña. Al etiquetar estos mensajes su difusión es minimizada, aunque las personas que siguen la cuenta aún pueden ver los mensajes.

Facebook también etiquetó un mensaje del mandatario estadounidense que hablaba sobre un eventual triunfo y luego sobre el presunto fraude. La red social optó por advertir a los electores sobre la situación del conteo de votos y dirigirlos hacia un espacio oficial de las elecciones.

“Añadimos notificaciones en Facebook e Instagram para indicar que el escrutinio de votos está en marcha y que aún no ha ganado”, puntualizó la red social.

Adicionalmente, la red cerró la cuenta de un grupo pro Trump que alcanzó los 350.000 integrantes y que supuestamente hacía llamados a la violencia y a parar el conteo de votos en estados claves para el triunfo presidencial.

Para los expertos en Marketing Digital, Oswaldo Moreno y Steven Luzuriaga, estos controles fueron positivos, pero hay que tomar recaudos para defender la libertad de expresión.

“Las decisiones de Facebook y Twitter fueron acertadas”, dijo Luzuriaga. Para él hay que destacar la decisión de Facebook de controlar la campaña política y etiquetar el contenido que puede desinformar, pero quiere que se aseguren los derechos de los usuarios.

“Es muy bueno porque hay más control. El problema es que puede abrir la puerta a algo peligroso porque le estas dando poder a una red social para que calle ciertos comentarios que considere que pueden desinformar. ¿Quién puede asegurar que el futuro esto sea en beneficio de una determinada tendencia política?”.

Para Luzuriaga este punto es determinante, aunque apoya el control y espera que se replique en otros procesos electorales.

Moreno comparte esa posición. Manifestó que las políticas aplicadas son un reflejo de lo que se avecina en redes sociales. “El hecho de que estas herramientas o espacios de comunicación van a ser regulados, creo que es correcto y eso ocurre en varios países de la región como Panamá y México”.

Él cree que la opinión no es peligrosa, sino la viralización de ese contenido, que describe como “estado de virilización”.

Software especial para detectar contenido malicioso

En 2018, Facebook inauguró su Centro de Operaciones Electorales, un espacio destinado para que sus expertos y sus más sofisticados programas informáticos frenen la desinformación.

Su primera labor apuntó a las elecciones intermedias en USA, donde se eligen a un porcentaje de integrantes para el Senado y de la Cámara de Representantes. Luego estuvieron en Europa, en la India y en América.

“En el centro reunimos a expertos de la empresa en la materia, incluidos los de nuestra inteligencia de amenazas, ciencia de datos, ingenieros de software, investigación, operaciones comunitarias y equipos legales, para el monitoreo en tiempo real que nos permita atender el abuso potencial que suceda en nuestra red”, informó Facebook.

Según la red social, los sistemas de IA de última generación identifican el contenido que puede violar sus políticas. Además, de analizar la emisión de anuncios, e investigar cuando existan intentos de interferencia nacional y extranjera en las elecciones.

Entre las herramientas digitales que usa este Centro están el Panel de Evaluación de Crisis (Crisis Assessment Dashboard – CAD por sus siglas en inglés), que les permite identificar en tiempo real y en todo el territorio estadounidense los contenidos que promuevan, por ejemplo, el odio o supresión de votos.

“Tenemos alertas para estos picos en las señales, que se dirigen a los equipos operativos que revisan el contenido en busca de tendencias de riesgo o posibles violaciones, y lo eliminan si determinamos que infringe nuestras reglas”.