Solo basta con revisar por 10 minutos los comentarios de las redes sociales de los medios e instituciones públicas y privadas para encontrar desde reflexiones y opiniones sobre el tema del ‘post’, pasando por memes y bromas hasta la información engañosa y falsa.

Por Ana María Carvajal

En medio de una incontrolable tormenta de comentarios, surgen aquellos maliciosos que podrían no solo confundir a las audiencias sino convertirse en un auténtico riesgo para la comunidad. Estas prácticas fueron más notorias durante la época más crítica de la pandemia, pues promovían el consumo de sustancias riesgosas para la salud como supuestos remedios para evitar el contagio de SARS-CoV2 o curar el covid-19.

Otros invitaban a la gente a rebelarse en contra de las autoridades sanitarias y los organismos internacionales que promovían el uso de la mascarilla y el distanciamiento social como medidas de prevención y, finalmente, se convirtieron en enemigos de las vacunas para disminuir la cantidad de gente que enferma gravemente por el virus.

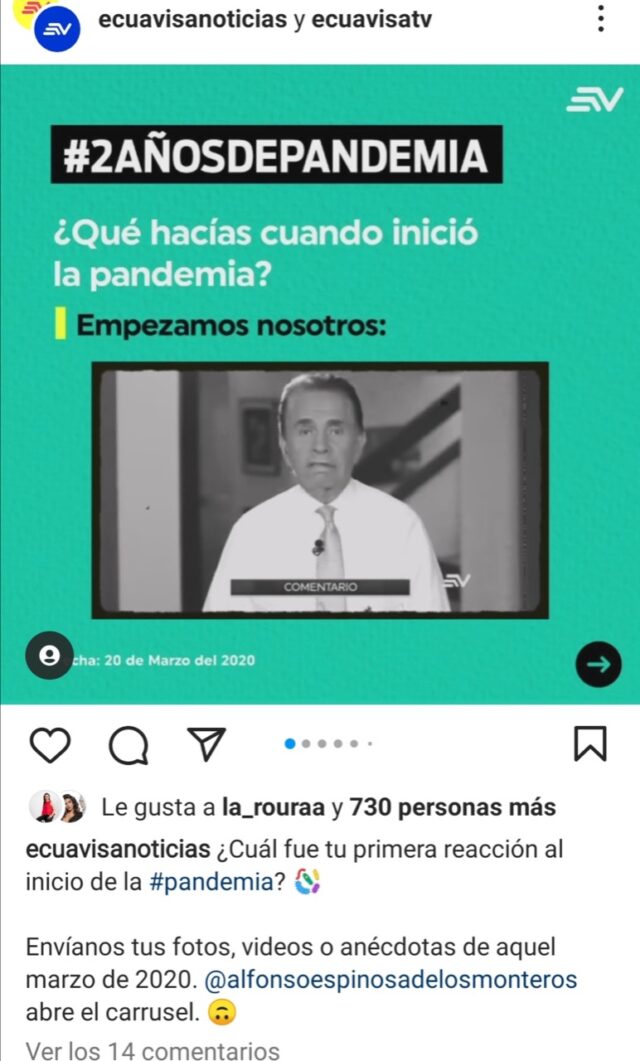

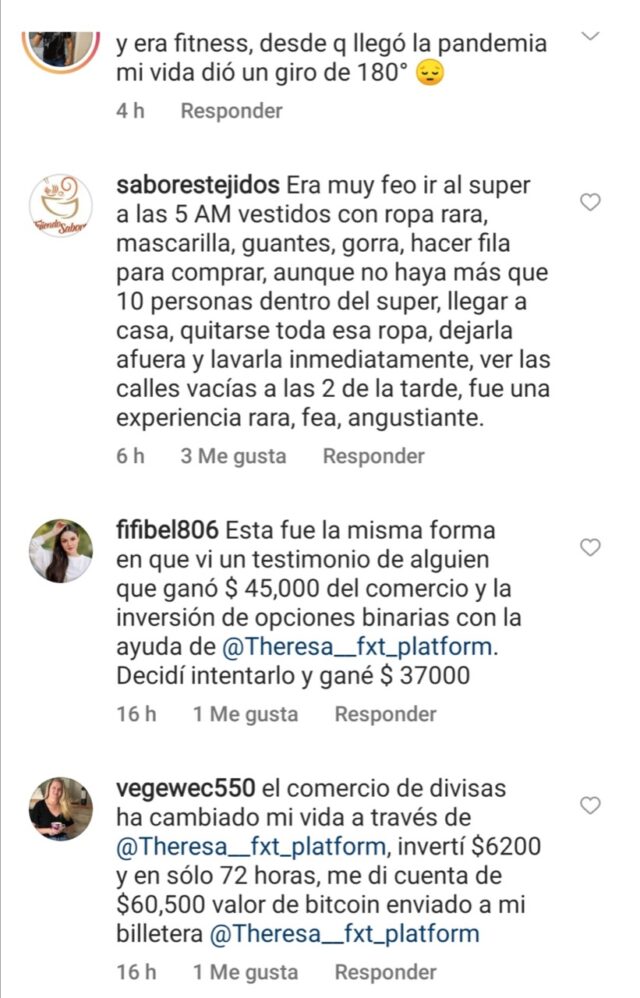

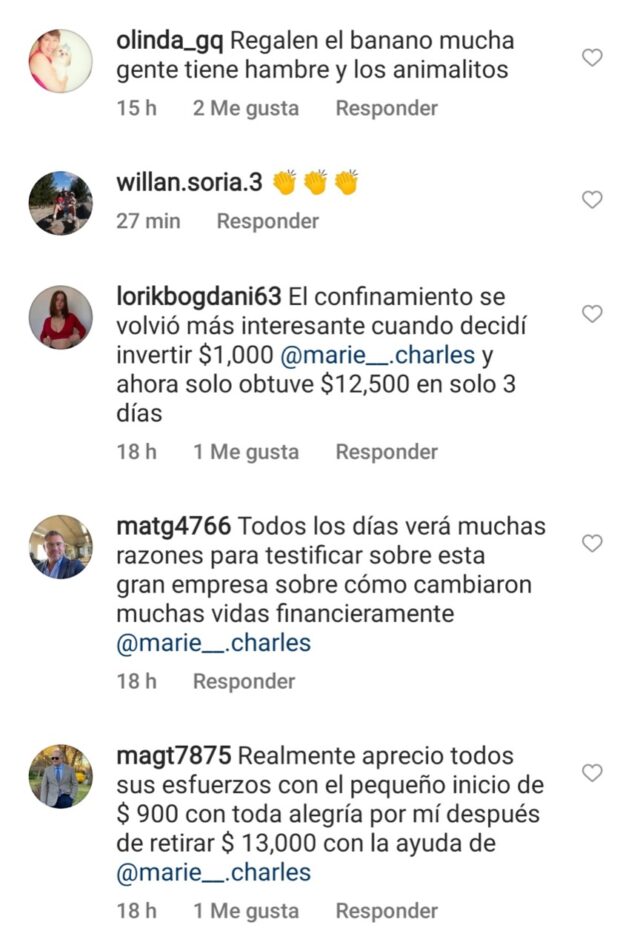

Sin embargo, una vez superada la peor parte de la crisis y cuando el fin de la pandemia se ve más cercano, la desinformación ataca de otros modos. Alfredo Viteri, community manager de Ecuavisa, señala que el nuevo coronavirus está dejando de ser el tema en los comentarios con contenido engañoso. El nuevo ‘boom’ son las fórmulas mágicas para ganar miles de dólares de manera fácil y rápida. “Antes teníamos ese tipo de comentarios a nivel comercial, pero últimamente la epidemia son las cuentas que te ofrecen ganar 5, 10, 50 mil dólares. Opinan sobre noticias y contenido del canal” para atraer a la gente.

Esta clase de textos y enlaces aparecen con más frecuencia en las publicaciones de las producciones del canal y las novelas extranjeras, pero también ocurre en espacios de noticias. En Ecuavisa se hace una revisión semanal de las interacciones en las entradas de sus redes para analizar el engagement (implicación emocional de la audiencia y su interacción con los programas que emite el medio) y allí se suele encontrar un promedio de cinco comentarios sobre dinero fácil por cada publicación, agrega Viteri.

En cada revisión, se decide eliminar este tipo de contenidos “no solo porque la información sea veraz o no, sino porque afecta a la experiencia del usuario”. A veces, los bulos no solo llegan por la vía de los comentarios sino que hay gente que crea cuentas para suplantar medios. Hace dos años, Ecuavisa encontró una página que decía ser la oficial de su noticiero Televistazo. “Está mandando noticias con comentarios casi siempre políticos. Obviamente la reportamos”, dice Viteri, pero en esos casos, cada plataforma responde distinto.

Al respecto, la catedrática de la Universidad San Francisco de Quito, María Dolores Brito-Rhor, recuerda que no se trata de borrar el mensaje de alguien que esté en contra de algún contenido, pero cree que sí es necesario eliminar comentarios de quien ofende, irrespeta y divulga noticias falsas, porque siempre hay personas dedicadas a desinformar, troles que multiplican mensajes con fines particulares y hasta quienes cometen delitos en el ciberespacio.

Cuando se ha tratado de este tipo de reportes en cada plataforma, los community de Ecuavisa han notado que Twitter es más rápido en atender los reclamos frente a Facebook, que se demora mucho más. Por eso, en la división digital del canal se decidió hacer una campaña para difundir la única cuenta de noticias que tiene el canal, a través de sus espacios oficiales. Así evitan mencionar cuentas falsas directamente, porque eso podría ocasionar un efecto Barbara Streisand, que ocurre cuando el reclamo público le dé más visibilidad a la cuenta denunciada en lugar de frenarla y termina por darle más seguidores. Frente a esos problemas, el canal tiene previsto aumentar la frecuencia de revisión de sus post.

Juan Carlos Ocaña, community manager de diario El Comercio, explica que en ese medio se presta atención a todo lo que llegue a sus redes, incluidos los mensajes internos. Los usuarios suelen enviar por esa vía información que el equipo analiza para corroborar su veracidad. Si se trata, por ejemplo, de un mensaje que informe sobre una riña o un accidente, el primer paso es contactar a fuentes oficiales o revisar si han publicado algo al respecto. “Si no lo hemos verificado, no se publica”.

Pero agrega que, en desastres como explosiones o deslaves, se coordina con los equipos periodísticos para que lleguen al lugar. Mientras tanto, el equipo web contacta a la persona que dio la alerta para confirmar su identidad y recabar más información que permita saber si el hecho narrado en realidad ocurrió.

En cuanto a los constantes informes que aparecen en portales de noticias, medios y agencias sobre las vacunas contra el SARS-CoV2, lo primero que se hace es revisar las investigaciones que difunden las universidades y, como no suele haber facilidad de llegar a los científicos directamente, se habla con los organismos locales, nacionales o internacionales o se busca en sus sitios oficiales para avalar los contenidos. “Al final todo es verificar”, subraya Ocaña.

Este trabajo, al igual que la revisión de comentarios, está a cargo de un equipo que procesa la información. Pero Ocaña indica que es una tarea delicada porque “existen muchos perfiles que publican contenidos falsos y el espacio de comentarios de nuestras redes debe ser seguro y la información debe ser confiable”. Sin embargo, no se puede olvidar que estos son espacios sociales y que, por su naturaleza, los lectores pueden tener posiciones contrapuestas. El poner límites a comentarios es complicado y la pandemia ha sido un ejemplo de ello porque dentro de esa coyuntura había “un trauma en la comunidad; se viralizaron imágenes de cuerpos amontonados, gente que supuestamente incineraba cadáveres, pero algunas correspondían al país y otras no. Ese tipo de contenidos generó una alarma social innecesaria”.

Sin embargo, el community manager recuerda que censurar contenidos no es ético, porque se deben propiciar espacios para que la gente se exprese. Su trabajo es siempre dejar en claro que el medio avala su contenido porque surge de una investigación y reportería que no se basa en improvisación, sino en un análisis riguroso. De ahí en más, “la gente es libre de decidir si aprecia nuestro contenido o si se fía de publicaciones falsas”. Pero hay casos en que, tras un análisis, se encuentran mensajes que incitan a un contenido falso o tóxico. En esos casos, se eliminan comentarios y se bloquea a esos usuarios.

Brito-Rhor coincide en que limitar los comentarios en cualquier rede social, más si pertenece a un medio de comunicación, es contraproducente, porque estas son de dos vías por su naturaleza de interacción, lo que las hace diferentes de la televisión o de un periódico, cuyo objetivo es emitir información en una sola vía. De ahí la importancia de contar con un community manager profesional, que pueda contrarrestar los problemas que pueden surgir en esa interacción en redes.

Aunque la salida más fácil sería desactivar los comentarios, es la que menos funciona. Además, en la actualidad se hace una diferencia entre dos cargos: el content manager, que es quien puede crear contenido y revisar el material publicado en línea, mientras que los community manager son la voz de una marca y el nexo entre esta y su audiencia. En las manos de ambos está vigilar la calidad tanto de lo que se difunde como de la interacción.

Además, se deben diferenciar los contenidos, agrega la docente. “Mi regla es si el comentario ofende o desinforma, se oculta, pero no si el comentario es negativo. Estos últimos son una excelente oportunidad porque si atiendo y respondo públicamente, la gente se dará cuenta de lo que hice bien, por lo que no solo recupero un cliente o lector, sino que consigo más. Debe haber sutileza al responder, porque quien contesta un comentario no es alguien con nombre y apellido sino la marca hablando”.

Tanto en Ecuavisa como en El Comercio, las épocas de elecciones nacionales o seccionales son en las que más información falsa se difunde. En esos meses, los perfiles falsos y maliciosos proliferan. Pero estos, según Ocaña, “son fáciles de identificar, porque suben contenido que no tiene nada que ver con los temas tratados y se nota claramente de qué posiciones políticas vienen”. Otro asunto común es la difusión de fotos antiguas o de otros lugares cuando ocurre algún desastre natural, para hacer creer a la gente que ocurrieron dentro del país. En esos casos también se borra el material y se bloquea a los usuarios.

Pero en medio de esa ola de desinformación que tanto daño hace, Ocaña prefiere destacar que es posible construir una comunidad positiva y eso es “mucho más importante de resaltar, porque nuestra comunidad es nuestra esencia y hemos crecido gracias a su aporte”.

“La mayoría -agrega- nos alerta y somos una especie de amigo que escucha y que valora sus aportes. Muchos nos pasan información útil y positiva, es lo más valioso que tenemos y es la que debemos cuidar porque no solo alimentan clics sino que permiten estar en el lugar de los hechos sin estar, nos dan guía para acudir a los sitios donde ocurre la noticia”.

Por eso, Brito-Rhor señala que si bien muchas veces los comunicadores se enfocan en las marcas y los centros de troles, por ejemplo, es más poderoso centrarse en los ciudadanos digitales. “Tenemos que educar y empoderar a la gente”, Cita el ejemplo de Wikipedia, que tiene a millones de personas alimentando su información. Señala que si bien hay personas atacando ese contenido, se calcula que en el sitio solo entre el tres y el cuatro por ciento del material es falso, mientras que en las bibliotecas ese porcentaje podría subir a un ocho por ciento. ¿Cómo lo lograron? Agregando referencias, dice, porque así se cuenta con más argumentos para decir que un contenido es verdadero.

“Como educadora, creo que todo empieza por ahí, que la gente no comparta los chats, que no hagan forward a los amigos, que analice de dónde viene un dato, qué tan cierto es. Se debe crear conciencia a la hora de compartir o comentar, que nos preguntemos si aportamos o no”, dice Brito-Rhor y lo resume en tres palabras: educación, empoderamiento e investigación, para tener un mundo digital más real. Y aún en ese contexto, al igual que en la calle, siempre va a haber delincuencia y malas intenciones, por lo que recomienda cuidarse de eso, de lo que compartimos y con quién. “No es lo mismo en persona, en televisión o solamente con la voz. Son diferentes sentidos los que están ahí y al digitalizar una relación, esta se deshumaniza y hay que tratar de humanizarla lo más posible a la hora de tener cualquier tipo de actividad digital”.